推荐模型适用于Stable Diffusion webUI 、ComfyUI、 ForgeUI

文章中推荐的所有模型,全部亲自用过。整理不易,如果对你有帮助,帮忙点个赞。

所有模型演示与实操落地均可在以下两门课程中学习

一、checkpoints大模型

1、SD1.5版本大模型

- SD1.5官方基础大模型:v1-5-pruned-emaonly.safetensors

出图效果差,一般不用来作图。主要用来模型训练、模型融合,出图演示。

- SD1.5官方基础大模型:v1-5-pruned.ckpt

- SD1.5官方基础修复大模型:sd-v1-5-inpainting.ckpt

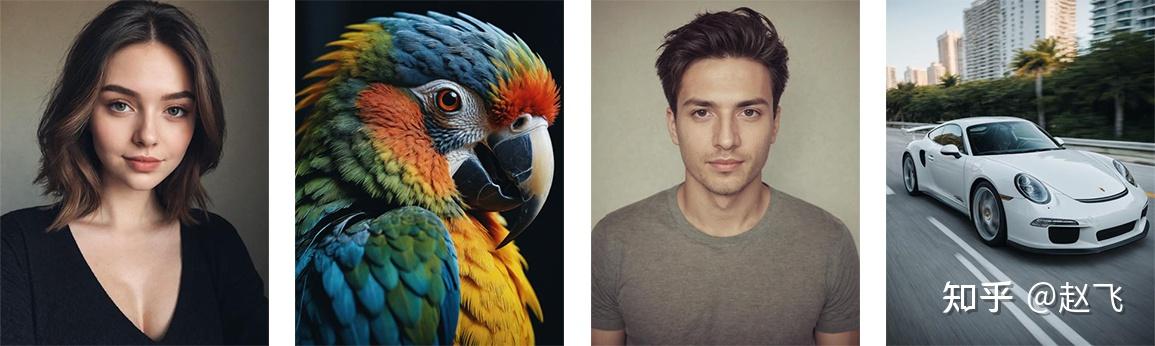

- 写实大模型:

realisticVisionV51\_v51VAE.safetensors

Realistic\_Vision\_V5.1-inpainting.safetensors 修复版本

较火的写实模型,制作真是照片效果。

- 适合动漫风格的大模型:revAnimated\_v122EOL.safetensors

- Dreamshape LCM大模型:LCM\_Dreamshaper\_v7\_4k.safetensors

LCM全称Latent Consistency Models(潜在一致性模型),可以通过几步推理合成高分辨率图像。

- 迪士尼皮克斯风格大模型:disneyPixarCartoon\_v10.safetensors

适合制作亚洲漂亮女孩图片。

- 美娜混合大模型:meinamix\_meinaV11.safetensors

- 虚幻写实大模型:dreamshaper\_8.safetensors

- 万象熔炉大模型:AnythingXL\_v50.safetensors

适合制作二次元图像。

2、SDXL版本大模型

- SDXL1.0官方基础模型:sd\_xl\_base\_1.0.safetensors

出图效果差,一般不用来作图。主要用来模型训练、模型融合,出图演示。

- SDXL1.0官方refiner模型:sd\_xl\_refiner\_1.0.safetensors

官方sd\_xl\_base\_1.0.safetensors模型配套的refiner,主要用来演示操作。后续的SDXL基本不需要使用refiner模型。

- SDXL写实大模型:realvisxlV40\_v40Bakedvae.safetensors

- SDXL turbo模型:sd\_xl\_turbo\_1.0\_fp16.safetensors

Turbo模型 是一种快速生成文本到图像的模型。

- SDXL lightning模型:sdxl\_lightning\_4step.safetensors

SDXL-Lightning 是一种闪电般快速的文本到图像生成模型。它可以通过几个步骤生成高质量的 1024px 图像。

- 巨无霸写实模型V8:juggernautXL\_v8Rundiffusion.safetensors

巨无霸写实模型V9:juggernautXL\_v9Rundiffusionphoto2.safetensors

- 亚洲人像模型:sdxl10ArienmixxlAsian\_v45Pruned.safetensors

dreamshaperXL\_alpha2Xl10.safetensors

3、SD3.0版本大模型

- 官方SD3大模型:sd3\_medium.safetensors

不含文本编码器,仅包含 MMDiT 和 VAE 权重,SD.Next 将根据需要自动加载 CLiP 模型

4、SD Audio版本模型

音频生成模型

1 .:https://pan.baidu.com/s/1EhB6QE4epY-NgzyTiYjUFg?pwd=3jif

5、FLUX版本大模型

- FLUX dev 压缩版本:flux1-dev-fp8.safetensors

- flux-2-klein-base-4b-fp8.safetensors:超强AI图片编辑:ComfyUI Flux.2 Klein部署教程(含模型与工作流)

- flux2\_dev\_fp8mixed.safetensors:这次真的要告别PS了:一篇文章讲清楚如何在ComfyUI中使用FLUX.2模型

二、Unet模型

1、SD1.5版本Unet模型

2、SDXL版本Unet模型

3、FLUX版本Unet模型

- :flux1-dev.safetensors

- :flux1-fill-dev.safetensors

- :flux1-kontext-dev.safetensors 模型下载与使用看此文章:ComfyUI Flux Kontext Dev模型使用教程

- :flux1-krea-dev.safetensors 模型下载与使用看此文章:FLUX.1-Krea-dev模型Comfyui最强文生图模型

三、VAE模型

1、SD1.5版本VAE模型

- vae-ft-ema-560000-ema-pruned.ckpt

- vae-ft-mse-840000-ema-pruned.ckpt

- color101VAE\_v1.safetensors

- vae-original.ckpt

- 适合漫画风格的VAE:kl-f8-anime2.ckpt

2、SDXL版本VAE模型

- SDXL官方配套VAE模型:sdxl\_vae.safetensors

- :vae\_transparent\_decoder.safetensors

3、FLUX版本VAE模型

- :ae.safetensors 安装路径:ComfyUI/models/vae/

4、其他VAE模型

- wan\_2.1\_vae.safetensors 通义万相WAN模型配套VAE

四、Clip文本编码模型

- stableDiffusion3SD3\_textEncoderClipG.safetensors

- stableDiffusion3SD3\_textEncoderClipL.safetensors

- stableDiffusion3SD3\_textEncoderT5E4m3fn.safetensors

- :t5\_base.safetensors

- :clip\_l.safetensors 安装路径:ComfyUI/models/clip/

- :t5xxl\_fp8\_e4m3fn.safetensors

- :clip-vit-large-patch14.safetensors.safetensors

- :t5xxl\_fp16.safetensors 安装路径:ComfyUI\models\clip

- :umt5\_xxl\_fp8\_e4m3fn\_scaled.safetensors

五、clip\_vision图像编码模型

- :CLIP-ViT-bigG-14-laion2B-39B-b160k.safetensors

- :CLIP-ViT-H-14-laion2B-s32B-b79K.safetensors

- :sigclip\_vision\_patch14\_384.safetensors

- :clip\_vision\_h.safetensors

六、LoRA模型

1、SD1.5版本LoRA模型

- 工笔画风格LoRA:MoXinV1.safetensors

- 盲盒风格LoRA:blindbox\_v1\_mix.safetensors

- 汉服风格LoRA:https://pan.baidu.com/s/1zIcU8nRzD8ffye4trM0lBA?pwd=i4ey

- 添加细节LoRA:more\_details.safetensors

- 霓虹效果LoRA:CyberPunkAI.safetensors

- 龙元素LoRA:dragon\_real\_base\_V1.safetensors

- 科幻风格LoRA:XSArchi\_127.safetensors

- 宫崎骏风格LoRA:Miyazaki.safetensors

- 快速生成LoRA:pcm\_sd15\_smallcfg\_2step\_converted.safetensors

2、SDXL版本LoRA模型

- lightningLoRA模型:sdxl\_lightning\_4step\_lora.safetensors

SDXL-Lightning 是一种闪电般快速的文本到图像生成模型。它可以通过几个步骤生成高质量的 1024px 图像

- :neo\_icon.safetensors

- :cutedoodle\_XL-000012.safetensors

- :outdoor-product-photography-SDXL.safetensors

- :xl\_more\_art-full\_v1.safetensors

- :Designer\_BlindBox-000015.safetensors

- :detailed.safetensors

3、FLUX版本LoRA模型

- :Brand\_Marks\_-\_Logo\_Icon\_Symbol.safetensors

- :cartoon\_logo\_flux\_lora.safetensors

- :CuteLogoMaker.safetensors

- :Graffiti\_Logo\_Style\_Flux.safetensors

- :logomaker1024-000008.safetensors

- :VibrantTech3D\_v1.safetensors

- :CharacterDesign-FluxV2.safetensors

- :FluxMythP0rtr4itStyle.safetensors

- :aidmaRealisticPeoplePhotograph-FLUX-V0.2.safetensors

- :OB拍立得人像摄影Instant camera portrait photography V2.0.safetensors

- :zyd232\_Hanfu\_Flux1D\_Ming\_PiFeng\_v1\_0.safetensors

七、IC-LoRA模型

In-Context LoRA(IC-LoRA)的核心概念是将条件图像和目标图像拼接成一张合成图像,同时使用自然语言来定义任务。这种方法可以无缝适应各种应用。

1、SD1.5版本IC-LoRA模型

2、SDXL版本IC-LoRA模型

3、FLUX版本IC-LoRA模型

- :Migration\_Lora\_cloth.safetensors 功能:持续的衣物迁移 高精度地在参考图像之间传递服装风格。

八、LyCORIS模型

1、SD1.5版本LyCORIS模型

- 微缩世界LyCORIS模型:miniature\_V1.safetensors

九、Embedding嵌入式模型

1、SD1.5版本Embedding模型

- 负嵌入Embedding:EasyNegative.safetensors

使用率极高的一款负面提示词 embedding 模型,可以有效提升画面的精细度。适合动漫大模型。

- 负嵌入Embedding:ng\_deepnegative\_v1\_75t.pt

适合实写大模型

- 正嵌入年龄滑块Embedding:

十、Hypernetwork超网络模型

1、SD1.5版本Hypernetwork模型

十一、Controlnet模型

1、SD1.5版本Controlnet模型

- 重上色Controlnet模型:ioclab\_sd15\_recolor.safetensors

- ip-adapter Controlnet模型:ip-adapter\_sd15.pth

- t2iadapterControlnet模型:

t2iadapter\_sketch\_sd15v2.pth

- :control\_v11e\_sd15\_ip2p.pth

- :control\_v11e\_sd15\_shuffle.pth

- :control\_v11f1e\_sd15\_tile.pth

- :control\_v11f1p\_sd15\_depth.pth

- :control\_v11p\_sd15\_canny.pth

- :control\_v11p\_sd15\_inpaint.pth

- :control\_v11p\_sd15\_lineart.pth

- :control\_v11p\_sd15\_mlsd.pth

- :control\_v11p\_sd15\_normalbae.pth

- :control\_v11p\_sd15\_openpose.pth

- :control\_v11p\_sd15\_scribble.pth

- :control\_v11p\_sd15\_seg.pth

- :control\_v11p\_sd15\_softedge.pth

- :control\_v11p\_sd15s2\_lineart\_anime.pth

2、SDXL版本Controlnet模型

- :control\_instant\_id\_sdxl.safetensors

- :ip-adapter\_instant\_id\_sdxl.bin

- :xinsircontrolnet-openpose-sdxl-1.0.safetensors

- :control-lora-canny-rank256-SDXL.safetensors

- :control-lora-depth-rank256-SDXL.safetensors

- :control-lora-recolor-rank256-SDXL.safetensors

- :control-lora-sketch-rank256-SDXL.safetensors

- :t2i-adapter-canny-sdxl-1.0.safetensors

- :t2i-adapter-depth-midas-sdxl-1.0.safetensors

- :t2i-adapter-depth-zoe-sdxl-1.0.safetensors

- :t2i-adapter-lineart-sdxl-1.0.safetensors

- :t2i-adapter-openpose-sdxl-1.0.safetensors

- :t2i-adapter-sketch-sdxl-1.0.safetensors

- :ip-adapter-plus\_sdxl\_vit-h.safetensors

- :ip-adapter\_sdxl.safetensors

- :CN-anytest\_v4-marged.safetensors

3、FLUX版本Controlnet模型

- :ip\_adapter.safetensors

- :flux-canny-controlnet-v3.safetensors

- :FLUX.1-dev-Controlnet-Inpainting-Betal.safetensors

- :flux\_dev\_openpose\_controlnet.safetensors

十二、sam模型

1、sam模型

2、sam2模型

Segment Anything Model 2 (SAM 2)是解决图像和视频中可提示的视觉分割问题的基础模型。

十三、其他语义分割模型

一个与图像解析或语义分割相关的模型文件,通常用于人体解析、场景解析等任务。它可能是基于 ParseNet 或其他类似架构的预训练模型。

十四、groundingdino模型

十五、GFPGAN模型

十六、Codeformer

十七、面部检测模型

十八、SVD模型

Stable Video Diffusion (SVD) 模型系列,是由 Stability AI 开发的一种基于扩散模型(Diffusion Model)的视频生成模型,能够从单张图像生成高质量的视频。

- svd\_xt.safetensors

- :stable-video-diffusion-img2vid-xt-1-1 huggingface项目文件包

十九、Zero123模型

Stable Zero123 是由 Stability AI 开发的一种基于 Zero123 技术的图像生成模型,专门用于从单张图像生成高质量的多视角 3D 物体视图

二十、layerdiffuse模型

1、SD1.5版本layerdiffuse模型

- :layer\_sd15\_fg2bg.safetensors

- :layer\_sd15\_joint.safetensors

- :layer\_sd15\_vae\_transparent\_decoder.safetensors

2、SDXL版本layerdiffuse模型

- :layer\_xl\_bg2ble.safetensors

- :layer\_xl\_bgble2fg.safetensors

- :layer\_xl\_fg2ble.safetensors

- :layer\_xl\_fgble2bg.safetensors

- :layer\_xl\_transparent\_attn.safetensors

- :layer\_xl\_transparent\_conv.safetensors

二十一、antelopev2模型

二十二、brushnet模型

BrushNet 是一种基于扩散的文本引导图像修复模型,可以即插即用地加入任何预训练的扩散模型中。

- :random\_mask.safetensors

- :segmentation\_mask.safetensors

- :diffusion\_pytorch\_model.safetensors 对应的配置文件:config.json

二十三、Fooocus模型

二十四、IPAdapter模型

1、SD1.5版本IPAdapter模型

- :ip-adapter\_sd15.safetensors

- :ip-adapter\_sd15\_light\_v11.bin

- :ip-adapter\_sd15\_vit-G.safetensors

- :ip-adapter-full-face\_sd15.safetensors

- :ip-adapter-plus\_sd15.safetensors

- :ip-adapter-plus-face\_sd15.safetensors

2、SDXL版本IPAdapter模型

- :ip-adapter\_sdxl.safetensors

- :ip-adapter\_sdxl\_vit-h.safetensors

- :ip-adapter-plus\_sdxl\_vit-h.safetensors

- :ip-adapter-plus-face\_sdxl\_vit-h.safetensors

3、FLUX版本IPAdapter模型

二十五、LaMa模型

基于傅里叶卷积的分辨率稳健大型掩模修复

二十六、MAT模型

二十七、Gligen模型

GLIGEN 在现有的预训练文本到图像扩散模型的基础上构建并扩展其功能,使其能够根据参考输入进行条件生成。

二十八、UnCLIP模型

UnCLIP 的主要功能是通过文本描述生成高质量的图像。它结合了 CLIP 的文本-图像对齐能力和扩散模型(Diffusion Model)的图像生成能力,能够生成与文本描述高度匹配的图像

二十九、llava模型

三十、wd-v1-4模型与模型字典

- :wd-v1-4-convnextv2-tagger-v2.onnx

- :wd-v1-4-convnextv2-tagger-v2.csv 字典

- :wd-v1-4-moat-tagger-v2.onnx

- :wd-v1-4-moat-tagger-v2.csv 字典

三十一、TripoSR模型

TripoSR 是由 Stability AI 和 Tripo AI 合作开发的快速前馈 3D 生成模型。

三十二、AnimateDiff模型

1、Motion modules模型

2、Motion LoRAs模型

- :v2\_lora\_PanLeft.ckpt

- :v2\_lora\_PanRight.ckpt

- :v2\_lora\_RollingAnticlockwise.ckpt

- :v2\_lora\_RollingClockwise.ckpt

- :v2\_lora\_TiltDown.ckpt

- :v2\_lora\_TiltUp.ckpt

- :v2\_lora\_ZoomIn.ckpt

- :v2\_lora\_ZoomOut.ckpt

三十三、InsightFace模型

InsightFace是一个开源的2D&3D深度人脸分析工具箱,主要基于PyTorch和MXNet。

1、inswapper模型

2、buffalo\_l模型

InsightFace 发布的 buffalo\_l 面部检测和识别模型

三十四、IC-Light模型

IC-Light全称“Imposing Consistent Light”,是一个操纵图像照明的项目

三十五、RMBG 模型

RMBG 是我们最先进的背景去除模型,旨在有效地将各种类别和图像类型的前景与背景分开。

三十六、SUPIR模型

模型实操案例:ComfyUI 模糊图像变清晰

三十七、BiRefNet模型

目前较好用的开源可商用背景抠除模型

- :COD.safetensors 一种用于隐蔽目标检测(COD)的预训练模型。

- :DIS.safetensors 一种用于二分图像分割(DIS)的预训练模型。

- :DIS-TR\_TEs.safetensor.safetensors 具有大量数据集的预训练模型。

- :General.safetensors 用于一般用例的预训练模型。

- :General-Lite.safetensors 用于一般用例的轻量级预训练模型。

- :General-Lite-2K.safetensors 用于一般用例的轻量级预训练模型,适用于高分辨率图像。 (最佳分辨率2560x1440).

- :HRSOD.safetensors 一种用于高分辨率显著目标检测(HRSOD)的预训练模型。

- :Matting.safetensors 一种使用无trimap matting的预训练模型。

- :Portrait.safetensors 人物肖像预训练模型。

- :birefnet-v1-lite.onnx

模型实操案例:ComfyUI 一键抠图

三十八、CatVTON模型

模型实操案例:ComfyUI 一键换装

三十九、Redux模型

FLUX Redux 是用于生成图像变化的所有 FLUX基础模型的适配器。给定一个输入图像,FLUX Redux 可以重现略有变化的图像,从而可以细化给定的图像。

模型实操案例:ComfyUI 一键换装

四十、MODNet模型

MODNet 是一个仅使用 RGB 图像输入的实时人像抠图模型

模型实操案例:ComfyUI 证件照制作

四十一、retinaface模型

离线人脸检测模型

四十二、PuLID模型

面部保持技术。Pure and Lightning ID Customization via Contrastive Alignment(通过对比对齐实现 Pure 和 Lightning ID 定制)

1、SD1.5版本PuLID模型

2、SDXL版本PuLID模型

3、FLUX版本PuLID模型

模型实操案例:ComfyUI 制作个人头像

四十三、facexlib模型

facexlib是一个基于 pytorch 的面部相关功能库,例如检测、对齐、识别、跟踪、面部恢复工具等。它仅提供推理(不提供训练)。

模型实操案例:ComfyUI 制作个人头像

四十四、BOPBTL 模型

老照片修复技术

_1._:BOPBTL checkpoints模型

模型实操案例:ComfyUI 老照片修复

四十五、Florence-2模型

Florence-2 是一种先进的视觉基础模型,它使用基于提示的方法来处理各种视觉和视觉语言任务。Florence-2 可以解释简单的文本提示来执行字幕、对象检测和分割等任务。

四十六、Dlib模型

人脸检测模型

四十七、Makeup模型

美妆迁移模型

5.:resnet50.pth

模型实操案例:ComfyUI 美妆迁移

四十八、LTX-Video 视频模型

LTX-Video 是第一个基于 DiT 的视频生成模型,能够实时生成高质量视频。它以 768x512 的分辨率生成 24 FPS 的视频,速度比观看速度更快。该模型在包含各种视频的大规模数据集上进行训练,可生成内容逼真、内容多样的高分辨率视频。我们为文本转视频以及图像+文本转视频用例提供了模型

模型实操案例:4-39 ComfyUI 文生视频与图生视频

四十九、WAN 视频模型

阿里巴巴旗下开源视频生成模型通义万相模型

模型实操案例:4-39 ComfyUI 文生视频与图生视频

五十、Depth-Anything-V2模型

- :depth\_anything\_v2\_vits.pth

- :depth\_anything\_v2\_vitb.pth

- :depth\_anything\_v2\_vitl.pth

- :depth\_anything\_v2\_vitg.pth

五十一、MimicMotion模型

模型实操案例:4-42 MimicMotion 小姐姐跳舞视频制作

五十二、DWPose模型

模型实操案例:4-42 MimicMotion 小姐姐跳舞视频制作

五十三、sonic模型

- :模型安装包:sonic模型

下载链接包含以下文件

模型实操案例:4-43 ComfyUI 数字人制作

五十四、TopazVideoAI模型

TopazVideoAI模型是用在TopazVideoAI软件中对视频进行放大、细节添加、帧差值等相关视频处理的模型

- :模型安装包:TopazVideoAI模型

模型实操案例:4-44 ComfyUI 视频放大

五十五、RVM模型

RVM 专为鲁棒的人体视频抠图而设计。与将帧作为独立图像处理的现有神经模型不同,RVM 使用循环神经网络来处理具有时间记忆的视频。RVM 可以在任何视频上实时执行抠图,而无需额外输入。

模型实操案例:4-45 ComfyUI 视频抠图

五十六、ProPainter模型

ProPainter:改进视频修复的传播和变换器

模型实操案例:4-46 ComfyUI 视频去水印与物体抹除

持续更新中……

原文来源:https://zhuanlan.zhihu.com/p/28932301846

评论 (0)